AI奇点网2024年7月24日报道丨AI资讯早报

当地时间7月23日,Meta在官网正式发布了新版的Llama 3.1大模型,它依旧是一款开源的大模型,而且是世界上目前最大参数量的开源模型。

简单来说,超大杯 Llama 3.1-405B 是 Meta 迄今为止发布的最强大的大语言模型,也是全球目前最强大的开源大模型,更是全球最强的大模型。

从Llama 3.1 开始,再也不需要争论大模型是开源路线更好,还是闭源路线更好。因为Llama 3.1 405B 凭借 4050 亿参数的体量,无可辩驳的实力证明无论是开源还是闭源,都不会影响到大模型的性能指标。

总结一下 Llama 3.1 模型的特点:

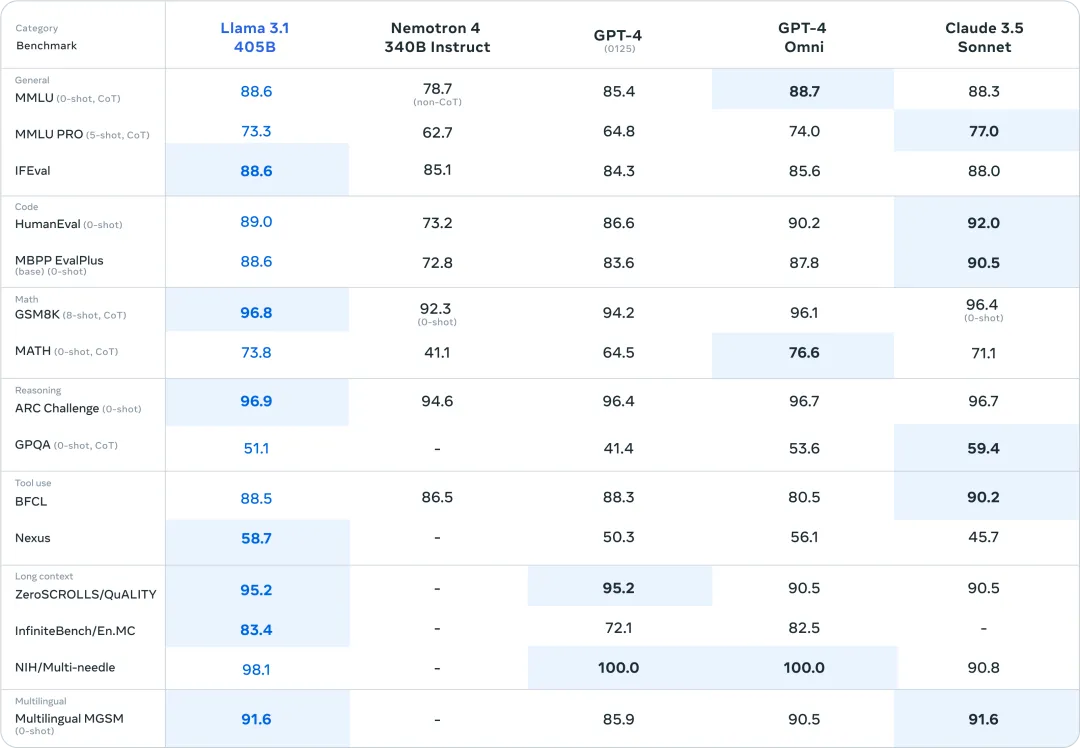

包含 8B、70B 和 405B 三个尺寸,最大上下文提升到了128K,支持多语言,代码生成性能优秀,具有复杂的推理能力从基准测试结果来看,Llama 3.1 超过了 GPT-4 0125.与 GPT-4o、Claude 3.5 互有胜负提供开放/免费的模型权重和代码,许可证允许用户进行微调,将模型蒸馏到其他形式,并支持在任何地方部署提供 Llama Stack API,便于集成使用,支持协调多个组件,包括调用外部工具面对 OpenAI 此前发布的最强闭源大模型 GPT-4o 和第一梯队的 Claude 3.5 Sonnet,超大杯依然有着一战之力,甚至仅从纸面参数上看,Llama 3.1 405B 标志开源大模型首次追上了闭源大模型。

细分到基准测试结果,Llama 3.1 405B 在 NIH/Multi-needle 基准测试的得分为 98.1,虽然从整理实力上,仍旧比不上 GPT-4o,但也表明其在处理复杂信息的能力上堪称完美。

附上Llama 3.1 的下载地址:

https://llama.meta.com/

喜欢

喜欢 顶

顶 无聊

无聊 围观

围观 囧

囧 难过

难过