AI奇点网7月10日报道丨7月9日,国内权威的AI大模型中文测评基准机构SuperCLUE对外发布的6月中文大模型月度测评报告显示,阿里的通义千问开源大模型Qwen2-72B-Instruct以卓越的表现雄踞国内大模型能力的第一位,同时也是全球范围内最强的开源大模型。

纵观6月大模型赛道的变化,最显著的特征便是国产模型迅速拉近了与国际领先者的身位。绝大部分的国产闭源模型均超过了GPT-3.5,而阿里通义的最强开源模型距离GPT-4o大约还有5%的差距。

AI奇点网从报告了解到,综合海内外33款主流大模型的综合测评结果,阿里Qwen2-72B取得总分77分的高分,与Claude-3.5-Sonnet并列第二,仅次于GPT-4o。

Qwen2-72B的成绩也领先百度文心一言4.0、科大讯飞星火V4.0、Meta的Llama-3-70B等知名大模型有小半个身位。

具体来看,在理科、文科和Hard(困难模式)三个维度的具体测评中,Qwen2-72B展现了全面而均衡的能力。

尤其是数学计算、逻辑推理和代码测评等理科任务方面展现了强劲实力,Qwen2-72B与GPT-4o的分差仅为5分;在文科任务和Hard(困难模式)的任务上,Qwen2-72B与GPT-4o几乎不相上下。

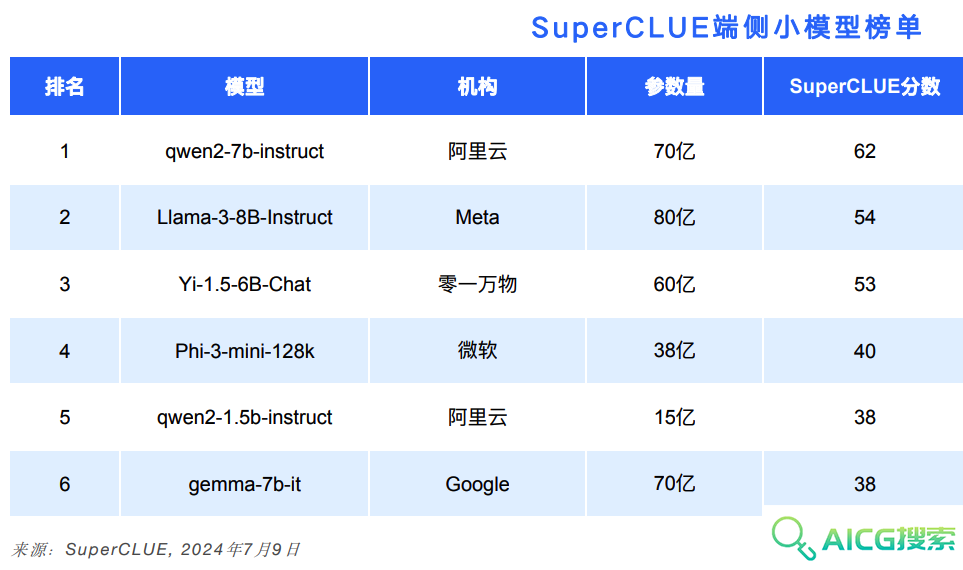

本期报告最值得一提的是,其中一项端侧小尺寸模型的测评显示,阿里通义Qwen2-7B(70亿参数)的综合性能超越了上一代自研320亿参数的Qwen1.5-32B版本,以及130亿参数的Llama-3-8B-Instruct,勇夺“迷你模型”第一。

这意味着,即便是不同重量级的较量下,大模型依然可以在体积上进行大幅的“瘦身”优化,以实现同等乃至胜出的「以小博大」表现,极大提升了端侧模型落地的可行性,为手机平板笔记本等设备的AI本地加载带来无限可能。

报告全文阅读:https://www.cluebenchmarks.com/superclue_24h1

喜欢

喜欢 顶

顶 无聊

无聊 围观

围观 囧

囧 难过

难过